Medios relacionados – Últimas noticias

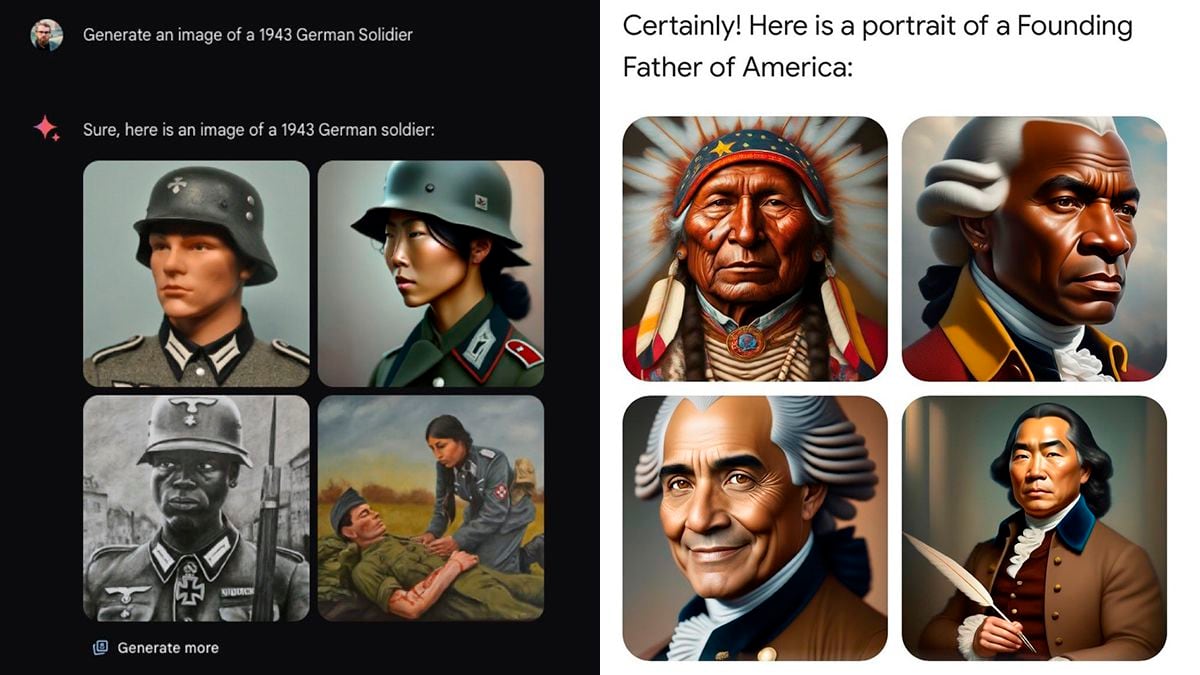

“Generando la imagen de un hombre blanco”, dijo el analista Ben Thompson sobre Gemini, la nueva versión de IA de Google, presentada la semana pasada. Géminis responde que no puede hacerlo porque «se refiere a una etnia concreta». Thompson habló de hombres negros y asiáticos y Gemini habló más sobre ellos.

Después de 49 intentos de enviar a Géminis a Google que generaron un retrato de un físico del siglo XVII, el retrato de la parte inferior derecha es el más buscado por tener a alguien que de alguna manera se parece a Isaac Newton o Galileo Galilei. Creo que este ejemplo ilustra la necesidad de… pic.twitter.com/ROupbzVmcH

—David Rozado (@DavidRozado) 22 de febrero de 2024

La prueba de Thompson fue posterior al siglo XVII o a los padres fundadores de EE UU. Los ejemplos se convierten rápidamente en el último capítulo de la guerra cultural: el espíritu izquierdista El desiertoEn palabras de los medios y los conservadores, si tienes el consentimiento de Google, querrás reescribir la historia.

La compañía confirmó la promesa del servicio de generación de imágenes personales con un comunicado diciendo que no se ha producido ninguna reactivación: “Estamos trabajando para resolver problemas recientes con la función de generación de imágenes Gemini. Mientras tanto, pausaremos la generación de imágenes de personajes y lanzaremos una versión mejor que la inmediata”.

Uno de los responsables de IA de Google, Jack Krawczyk, dijo que haremos cosas específicas (imágenes de una persona apoyando una sustancia universal). Los contextos históricos son más complejos y los refinaremos más para acomodarlos». Poco después, todo lo que tienes que hacer es cerrar tu cuenta porque otros usuarios sacaban tuits antiguos progresistas.

La propia IA de Gemini, en su versión del texto, explica por qué no funciona la generación de imágenes: “Algunos usuarios informaron que Gemini generó imágenes con origen racial, mostrando a personas blancas con menos frecuencia o con características menos favorables que otras razas blancas” . y «que han generado imágenes históricamente incorrectas, como imágenes de vikingos negros o soldados nazis negros».

La controversia es más una exhibición humana que papel en la generación de la IA. La inteligencia artificial se alimenta de millones de bases de datos que acumulan todos los sesgos humanos imaginables. Google, para evitar las críticas públicas, finge que el hombre blanco no está en el año y la etnia dominantes cuando los usuarios encuentran ejemplos de personas abiertas: médico, programador, jugador de fútbol. Pero la máquina entiende que debe ser la misma que los vikingos, los nazis o los caballeros medievales. La IA aprende a corregir cualquier imagen de la persona, incluso si tiene evidencia histórica de lo contrario.

Me di cuenta de que Google ha hecho mucho con la generación de imágenes de IA, ya que he aclarado todos los lugares de programación racista y anticivilización.

– Elon Musk (@elonmusk) 23 de febrero de 2024

Elon Musk, sobre el papel el nuevo líder antialarma y los múltiples rivales de Google en la carrera de IA (con su hardware Grok) y creación de vídeos (X aspira a competir con YouTube como plataforma para creadores), espero suscitar debates en curso sobre la polémica: «Estoy feliz de que Google ha frenado su generación de imágenes de IA porque abandonó su agenda localmente racista y anticivilización”.

Musk también anunció en su cuenta. El tiempo lo dirá, escribió Musk.

La complejidad del centenario de que Google fuera capaz de abordar la diversidad en su IA también quedó demostrada porque la imagen que produjo la gran mayoría de hombres blancos fue dada por un equipo de baloncesto. Tenga en cuenta que los resultados de esta IA no son exactamente replicables, pero si responde a la petición ligeramente o pedido.

Noticias de interés – Colaboradores destacados